Hadoop 伪分布式配置

创建Hadoop用户:

sudo useradd -m hadoop -s /bin/bash # 创建hadoop用户

sudo passwd hadoop # 修改密码

sudo adduser hadoop sudo # 增加管理员权限注销并使用 Hadoop 用户登录,接着更新 apt 并且安装 vim:

sudo apt-get update # 更新apt

sudo apt-get install vim # 安装vim安装SSH,配置无密码登录:

sudo apt-get install openssh-server

cd ~

mkdir .ssh # 可能该文件已存在,不影响

cd ~/.ssh/

ssh-keygen -t rsa # 会有提示,都按回车就可以

cat id_rsa.pub >> authorized_keys # 加入授权安装Java环境:

sudo apt update

sudo apt-get -y install openjdk-11-jdk

sudo vim /etc/environment # 设置JAVA_HOME在文件最前面添加如下单独一行:

vim的基本用法请进:点击查看vim的基本用法

JAVA_HOME="/usr/lib/jvm/java-11-openjdk-amd64"使 JAVA_HOME 变量生效:

source /etc/environment安装 Hadoop 2:

最新的 Hadoop 2 稳定版可以通过https://mirrors.cnnic.cn/apache/hadoop/common/hadoop-2.10.1/或者http://mirrors.cnnic.cn/apache/hadoop/common/stable/下载。

如果在官网下载慢并且本地有较好的网络也可以在微云网盘下载:hadoop2.10.1

cd ~/下载 #下载为安装包的文件夹

sudo tar -zxvf ./hadoop-2.10.1.tar.gz -C /usr/local # 解压到/usr/local中

cd /usr/local/

sudo mv ./hadoop-2.10.1/ ./hadoop # 将文件夹名改为hadoop

sudo chown -R hadoop ./hadoop # 修改文件权限进行伪分布式配置:

修改配置文件 core-site.xml (vim /usr/local/hadoop/etc/hadoop/core-site.xml):

<configuration>

<property>

<name>hadoop.tmp.dir</name>

<value>file:/usr/local/hadoop/tmp</value>

<description>Abase for other temporary directories.</description>

</property>

<property>

<name>fs.defaultFS</name>

<value>hdfs://localhost:9000</value>

</property>

</configuration>修改配置文件 vim /usr/local/hadoop/etc/hadoop/hdfs-site.xml:

<configuration>

<property>

<name>dfs.replication</name>

<value>1</value>

</property>

<property>

<name>dfs.namenode.name.dir</name>

<value>file:/usr/local/hadoop/tmp/dfs/name</value>

</property>

<property>

<name>dfs.datanode.data.dir</name>

<value>file:/usr/local/hadoop/tmp/dfs/data</value>

</property>

</configuration>启动 Hadoop:

cd /usr/local/hadoop

bin/hdfs namenode -format # namenode 格式化

sbin/start-dfs.sh # 开启守护进程

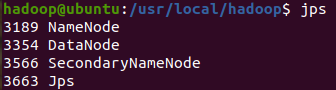

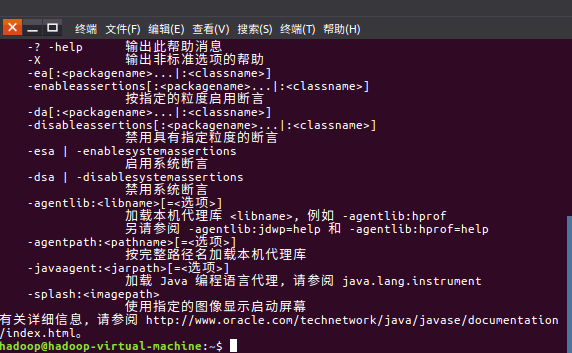

jps # 判断是否启动成功若成功启动则会列出如下进程:

NameNode、DataNode和SecondaryNameNode。

如图所示:

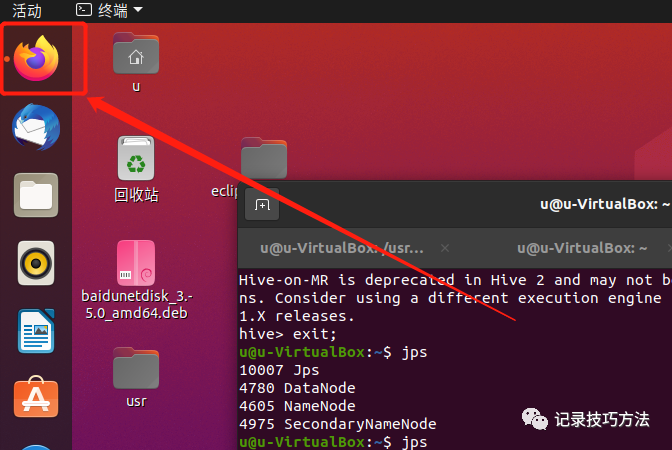

有的话就百分之九十没问题,然后剩下的百分之十要用浏览器去验证有没有成功,点击左上角的浏览器

输入网址:http://localhost:50070/,出现以下界面

现在就已经完完全全配置好hadoop伪分布式了,good!

运行 WordCount 实例:

bin/hdfs dfs -mkdir -p /user/hadoop # 创建HDFS目录

bin/hdfs dfs -mkdir input

bin/hdfs dfs -put etc/hadoop/*.xml input#将配置文件作为输入

bin/hadoop jar share/hadoop/mapreduce/hadoop-mapreduce-examples-*.jar grep input output 'dfs[a-z.]+'

bin/hdfs dfs -cat output/* # 查看输出OC此为Hadoop安装配置的基本流程,其他细节需要或者安装配置中出现的问题,请大家补充。

若有其他问题,望大家指正。

![表情[tuosai]-阳光明媚](https://www.cnzxv.cn/wp-content/themes/zibll/img/smilies/tuosai.gif)

![表情[xiaojiujie]-阳光明媚](https://www.cnzxv.cn/wp-content/themes/zibll/img/smilies/xiaojiujie.gif)

- 最新

- 最热

只看作者